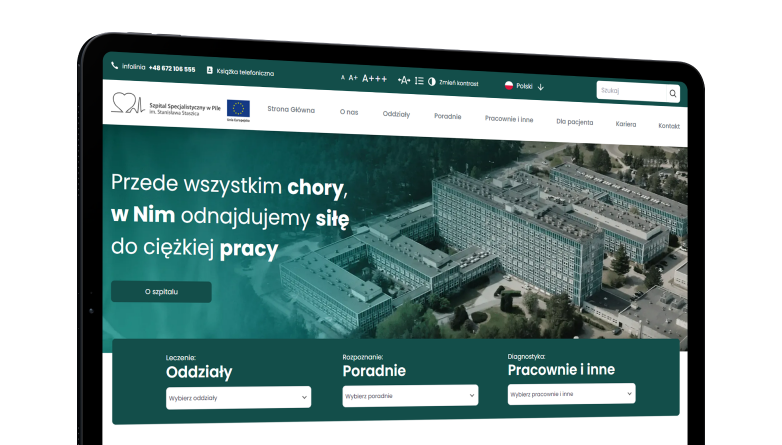

Dedykowane strony internetowe - czy warto?

Dedykowane strony internetowe to odpowiedź na coraz częściej stawiane przez konkurencję wyzwania.

Refaktoryzacja kodu to proces modyfikacji istniejącego kodu źródłowego przez Software House, mający na celu jego poprawę bez wpływania na działanie zewnętrzne aplikacji. Celem refaktoryzacji jest zwiększenie czytelności kodu, ułatwienie jego konserwacji oraz usprawnienie struktury wewnętrznej oprogramowania, co może pomóc w redukcji błędów i ułatwić wprowadzanie nowych funkcji w przyszłości. Refaktoryzacja jest kluczowym elementem utrzymania wysokiej jakości kodu w dłuższej perspektywie. Warto zwrócić na to szczególną uwagę w przypadku gdy posiada się profesjonalne i dedykowane strony internetowe, sklepy internetowe i systemy B2B. W projektach webowych i e-commerce refaktoryzacja kodu bardzo często pojawia się jako element długofalowego rozwoju systemu, a nie jednorazowej realizacji dlatego też przy istotnych dla firm systemach warto postawić na długofalowy rozwój systemów webowych. Refaktoryzacja to zadanie realizowane przez doświadczony software house, który zna architekturę systemu i cele biznesowe projektu.

Refaktoryzacja kodu jest szczególnie przydatna w projektach, które ewoluują w czasie. Przykładowe sytuacje, w których refaktoryzacja przynosi realne korzyści to:

Takie praktyczne przypadki pokazują, że refaktoryzacja to nie tylko „czyszczenie kodu”, ale krok, który może pozytywnie wpłynąć na stabilność i elastyczność całego projektu.

Refaktoryzacja kodu może być konieczna, gdy kod źródłowy staje się trudny do zrozumienia lub utrzymania.

Oto kilka sygnałów wskazujących na konieczność refaktoryzacji kodu:

Refaktoryzacja kodu może być konieczna, gdy pojawiają się powyższe sygnały, aby zapewnić, że kod jest czytelny, łatwy do utrzymania, elastyczny i wydajny. W praktyce refaktoryzacja bardzo często jest rekomendowana po audycie technicznym lub UX, który ujawnia problemy strukturalne w kodzie dlatego też często rekomendujemy audyt techniczny strony internetowej.

Refaktoryzacja kodu przynosi wiele korzyści, wśród nich, za najważniejsze można uznać:

Refaktoryzacja sprzyja utrzymaniu kodu w dobrym stanie, co jest kluczowe dla długoterminowej zrównoważonej pracy nad projektem. Lepsza jakość kodu przekłada się bezpośrednio na wydajność, stabilność i bezpieczeństwo strony internetowej lub aplikacji – ważna jest także w wielu przypadkach optymalizacja wydajności strony internetowej.

Refaktoryzacja może przyjmować różne formy – od prostych działań po bardziej zaawansowane techniki. Przykładowe praktyki to:

Te techniki to fundament dobrych praktyk inżynierskich, które mogą znacząco podnieść jakość i przewidywalność cięższych projektów software’owych.

Koszt refaktoringu kodu może się różnić w zależności od kilku czynników, takich jak rozmiar aplikacji, stopień skomplikowania kodu, doświadczenie programistów i czas potrzebny na wykonanie refaktoringu. W zależności od tych czynników, koszt refaktoringu może wynosić od kilkudziesięciu do kilkuset godzin pracy programisty. Refaktoring kodu jest jednak inwestycją w jakość oprogramowania, która może przynieść korzyści w postaci łatwiejszego zarządzania kodem, zwiększenia jego czytelności oraz ułatwienia wprowadzania nowych funkcji czy naprawiania błędów. Dlatego mimo kosztów, refaktoring może się opłacać w dłuższej perspektywie czasowej.

Refaktoryzacja kodu źródłowego aplikacji zazwyczaj się opłaca, gdyż istotnie poprawia jakość kodu, co przekłada się na łatwiejsze utrzymanie i rozwijanie aplikacji w przyszłości, zmniejszając tym samym koszty długoterminowe.

Opłacalność refaktoryzacji kodu źródłowego polega na zrównoważeniu kosztów i korzyści wynikających z tego procesu. Refaktoring może być opłacalny z kilku powodów:

Choć refaktoring kodu może początkowo wymagać nakładu pracy i czasu, korzyści płynące z poprawy jakości i czytelności kodu mogą przewyższyć te koszty, co sprawia, że refaktoring jest opłacalną inwestycją dla długoterminowego sukcesu projektu.

Jednak decyzję o refaktoryzacji warto podjąć po dokładnej analizie kosztów i potencjalnych korzyści, zwłaszcza w krótkim okresie czasu. Koszt refaktoryzacji jest silnie powiązany z wcześniejszymi decyzjami projektowymi oraz jakością początkowego wdrożenia i mocno zależy od tego jak przebiegał proces tworzenia strony internetowej lub systemu.

Spotkajmy się online na krótką, darmową 30 minutową konsultację! Omówimy na niej Twoje potrzeby i podpowiemy optymalne rozwiązania dla realizacji Twoich celów.

Aby uniknąć refaktoryzacji, warto stosować dobre praktyki programistyczne od początku projektu, takie jak regularny code review, stosowanie zasad czystego kodu, testowanie jednostkowe i integracyjne, a także stosowanie zasad SOLID.

Code review to proces, w którym inny programista (lub kilku) sprawdza kod źródłowy napisany przez kolegę z zespołu, aby upewnić się, że jest on zgodny ze standardami jakości, jest czytelny i nie zawiera błędów. Celem code review jest nie tylko identyfikacja potencjalnych problemów w kodzie, ale również wymiana wiedzy i doświadczeń między programistami, co przyczynia się do wzrostu jakości kodu oraz rozwijania umiejętności w zespole.

Testy jednostkowe są to procedury testowania oprogramowania, które sprawdzają indywidualne komponenty kodu, nazywane jednostkami, w izolacji od reszty systemu. Ich celem jest potwierdzenie, że poszczególne fragmenty kodu działają zgodnie z oczekiwaniami, spełniając określone wymagania funkcjonalne i niepoddające się niepożądanym błędom czy nieoczekiwanym zachowaniom. Testy jednostkowe są zazwyczaj automatyzowane i wykonywane wielokrotnie podczas procesu rozwijania oprogramowania, co pozwala na szybkie wykrywanie i naprawianie błędów oraz utrzymanie wysokiej jakości kodu.

Testy integracyjne są to procedury testowania oprogramowania, które sprawdzają, czy poszczególne komponenty (jednostki) lub całe moduły programu współpracują ze sobą poprawnie i efektywnie integrują się w większą całość, jaką jest aplikacja lub system. Ich celem jest zweryfikowanie, czy poszczególne części aplikacji łączą się ze sobą zgodnie z oczekiwaniami, przesyłają i odbierają dane poprawnie oraz wykonują wspólne zadania zgodnie z założeniami projektowymi. Testy integracyjne pomagają upewnić się, że wszystkie komponenty działają poprawnie razem, co zapobiega błędom wynikającym z niekompatybilności między nimi.

Zasady SOLID to pięć podstawowych zasad programowania obiektowego, które pomagają w tworzeniu oprogramowania łatwiejszego w utrzymaniu i rozbudowie. Są to:

Stosowanie tych zasad sprzyja tworzeniu kodu, który jest bardziej modularny, elastyczny i łatwiejszy w testowaniu. Przekłada się to w dłuższej perspektywie czasowej na optymalizację kosztów związanych z onboardingiem nowych programistów do projektu.

Kluczowym jest również ciągłe utrzymywanie aktualnej dokumentacji projektu oraz zapewnienie wzorowej komunikacji w zespole pracującym nad rozwojem projektu. Planowanie i projektowanie systemu z uwzględnieniem przyszłej rozszerzalności i utrzymania również pomaga uniknąć konieczności późniejszej refaktoryzacji kodu – co w przypadku dużych, rozbudowanych projektów programistycznych może za sobą ciągnąć bardzo duże koszty. Kluczowe znaczenie ma tu również wybór odpowiedniego zespołu developerskiego oraz stosowanie dobrych praktyk od początku projektu – czyli wybór wybór software house do projektu IT.

Jeśli refaktoryzacja kodu to coś, co rozważasz dla swojego projektu lub chcesz wdrożyć dobre praktyki utrzymania kodu (np. code review, modularność czy TDD), zobacz nasze usługi wsparcia technicznego i modernizacji aplikacji.

Sprawdź w jaki sposób pomagamy naszym Klientom jako:

Refaktoryzacja kodu to proces poprawy struktury istniejącego kodu bez zmiany jego funkcjonalności. Jej celem jest zwiększenie czytelności, jakości i łatwości dalszego rozwoju systemu.

Refaktoryzację warto przeprowadzić, gdy kod staje się trudny w utrzymaniu, zawiera duplikaty, jest słabo udokumentowany lub gdy planowany jest dalszy rozwój systemu i dodawanie nowych funkcji.

Nie. Prawidłowo wykonana refaktoryzacja nie zmienia sposobu działania aplikacji dla użytkownika, a jedynie poprawia jej wewnętrzną strukturę i stabilność.

Koszt refaktoryzacji zależy od skali projektu, jakości istniejącego kodu i zakresu zmian. W dłuższej perspektywie często obniża koszty rozwoju i utrzymania systemu.

Tak. Refaktoryzacja bardzo często realizowana jest etapami, równolegle z rozwojem projektu, co pozwala ograniczyć ryzyko i zachować ciągłość działania systemu.

Tak. Testy (szczególnie automatyczne) są kluczowe, aby upewnić się, że refaktoryzacja nie wprowadziła błędów i że system działa zgodnie z założeniami.

Ten wpis stworzył

Założyciel Webtom.pl, lider, który z pasją kształtuje przyszłość branży cyfrowej od 2005 roku. Dusza firmy, wprowadzająca w życie innowacyjne strategie, które transformują sposób, w jaki tworzymy i doświadczamy web designu i technologii internetowych. Wykorzystuje potęgę internetu do rozwoju biznesu naszych Partnerów.